第19期--天山胜利隧道

一、刊首图

世界最长的高速公路隧道“天山胜利隧道”本周贯通,长达22.13公里,汽车要在里面开20分钟。它连接了被天山隔断的南疆和北疆

二、时事新闻

三、技术文章

1、Qwen2.5-LLM:扩展大型语言模型的边界(中文)

阿里通义千问官方发布的文章,其中有关于Qwen2.5大模型介绍、与其他模型的推理效果对比。

四、开源组件

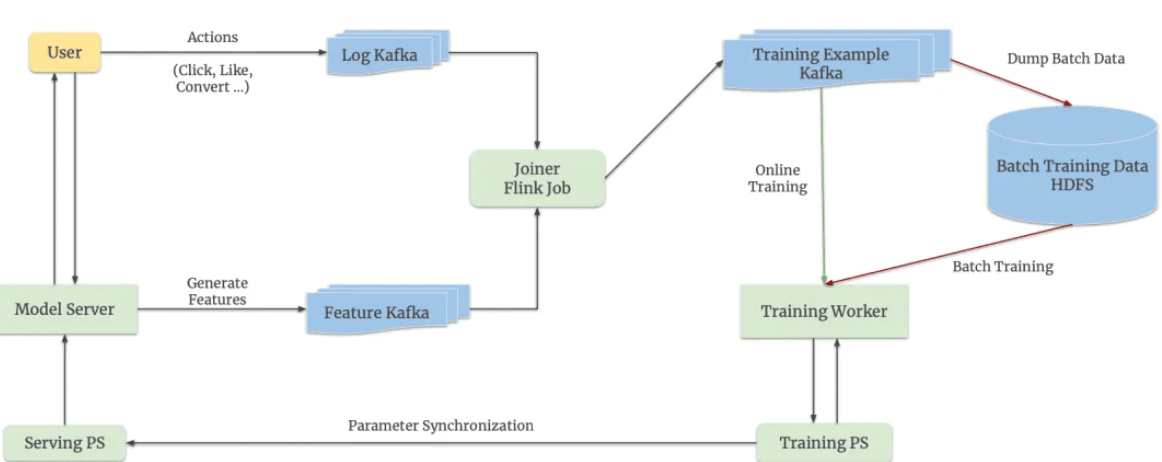

1、monolith

Monolith 是一个基于 TensorFlow 构建的大规模推荐模型深度学习框架,支持批量和实时训练及服务。

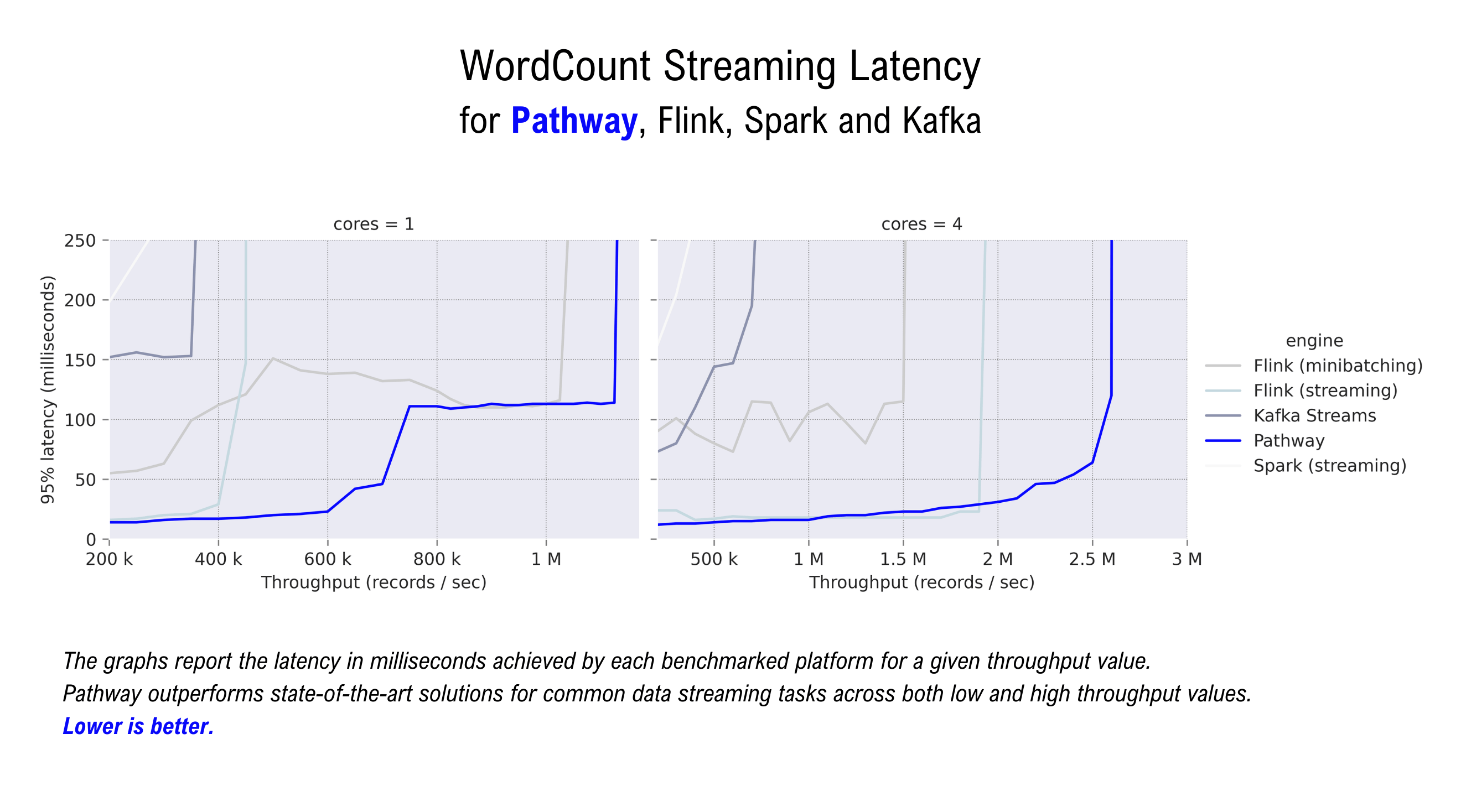

2、pathway

Pathway 是一个 Python ETL 框架,用于流处理、实时分析、LLM 管道和 RAG。尽管 Pathway 是用 Python 编写的,但它是由 Rust 引擎运行,从而实现多线程、多处理和分布式计算。

Qwen-Agent是一个开发框架,可用来开发Agent应用,充分利用基于Qwen模型的指令遵循、工具使用、规划、记忆能力。本项目也提供了浏览器助手、代码解释器、自定义助手等示例应用。

AgiBot World数据集诞生于智元自建的大规模数据采集工厂与应用实验基地,一方面为机器人大规模数据训练提供场地,另一方面真实复刻了家居、餐饮、工业、商超和办公五大核心场景,全面覆盖了机器人在生产、生活中的典型应用需求。

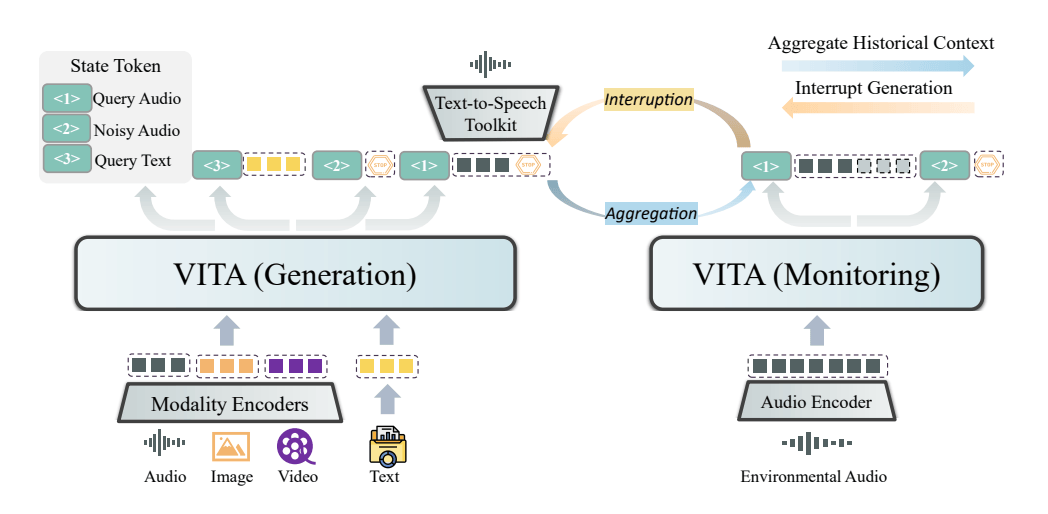

5、VITA

VITA是腾讯优图实验室推出的首个开源多模态大语言模型,支持同时处理视频、图像、文本和音频。它具备中英文双语理解与生成能力,提供无唤醒交互和音频打断等自然交互功能。论文地址

6、outlines

Outlines 是一个帮助用户简单稳定地使用 LLM 的 Python 库,支持基于正则表达式、JSON 和语法规则实现结构化输出。

一个基于LangGraph、FastAPI和Streamlit构建的完整工具集,旨在帮助开发者快速构建和运行AI代理服务。

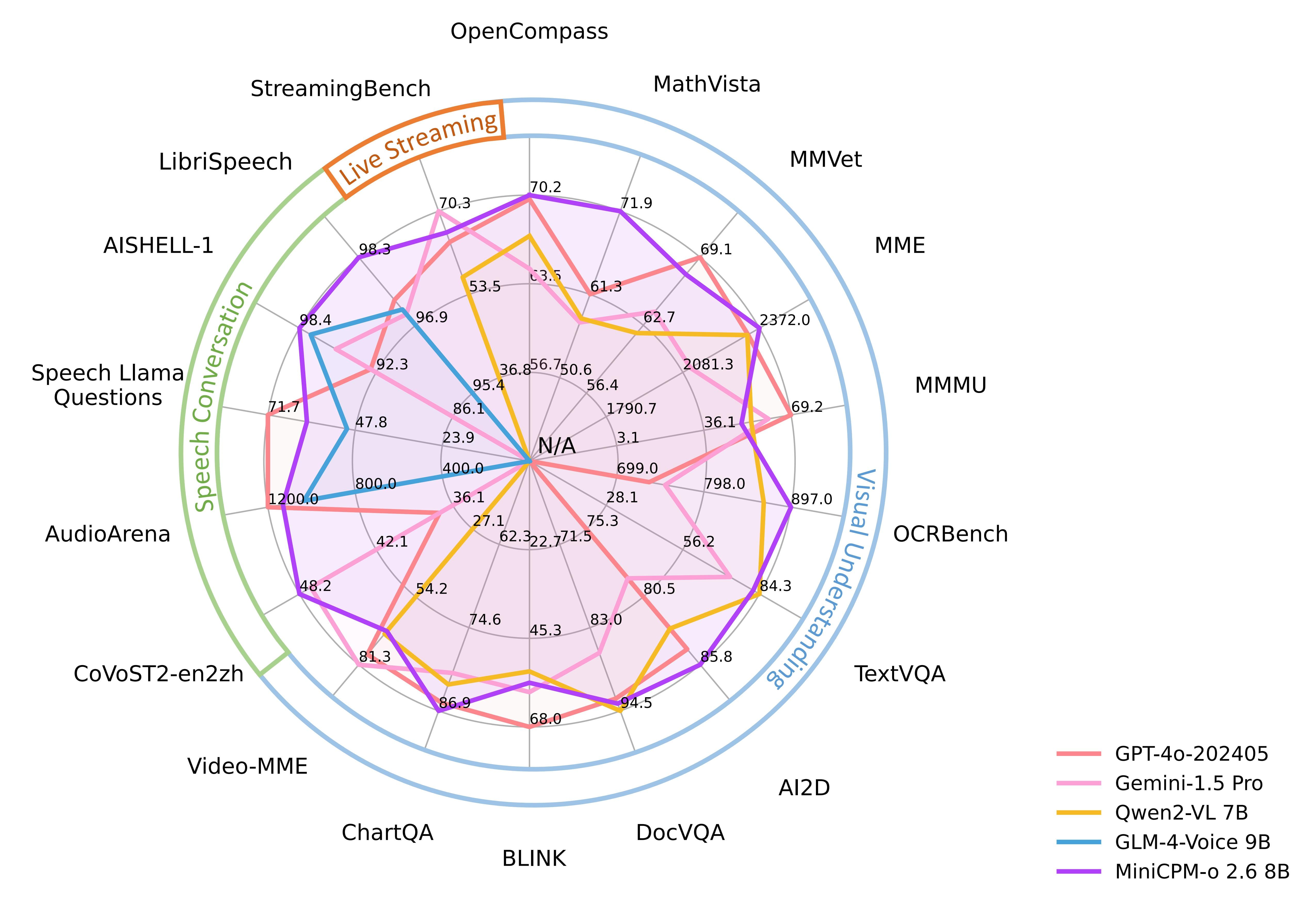

MiniCPM-o系列模型可以以端到端方式,接受图像、视频、文本、音频作为输入,并生成高质量文本和语音输出。

RealtimeSTT是一个强大、高效、低延迟的语音转文本库,具有先进的语音活动检测、唤醒词激活和即时转录功能。

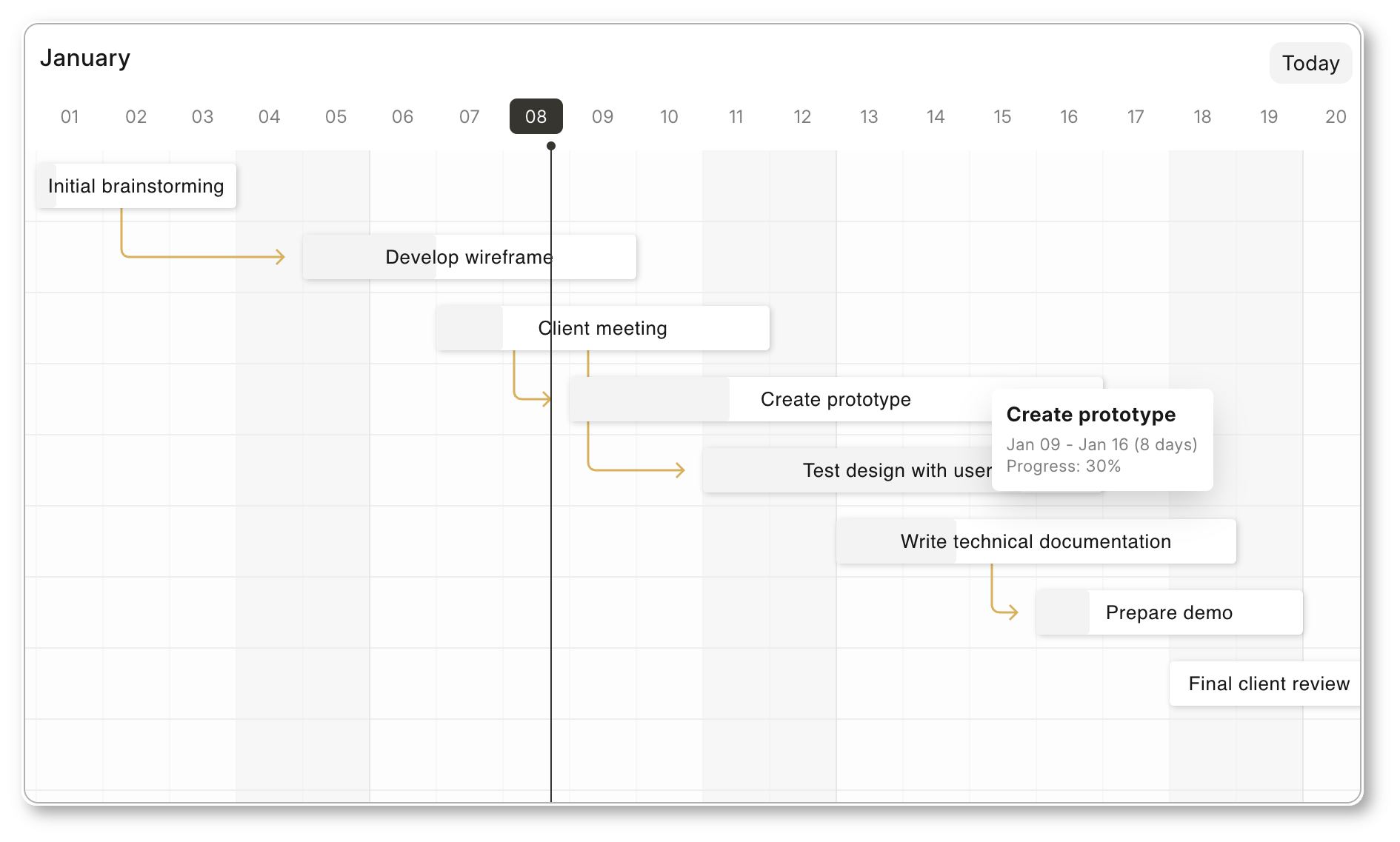

10、Frappe Gantt

Frappe Gantt是一款开源的JavaScript 甘特图库,具有简洁的界面和丰富的交互功能。

11、SemHash

SemHash是一个轻量且灵活的工具,用于通过语义相似性来去重数据集。它结合了Model2Vec的快速嵌入生成和Vicinity的高效ANN相似性搜索,支持单数据集去重(例如,清理训练集)和多数据集去重(例如,确保测试集和训练集之间没有重叠)。

五、工具软件

1、AutoMouser(开源)

一个 Chrome 浏览器插件,将鼠标操作通过 AI 转为 Selenium Python 脚本。

2、EmojiClick(免费)

使用自然语言搜索 Emoji 符号。

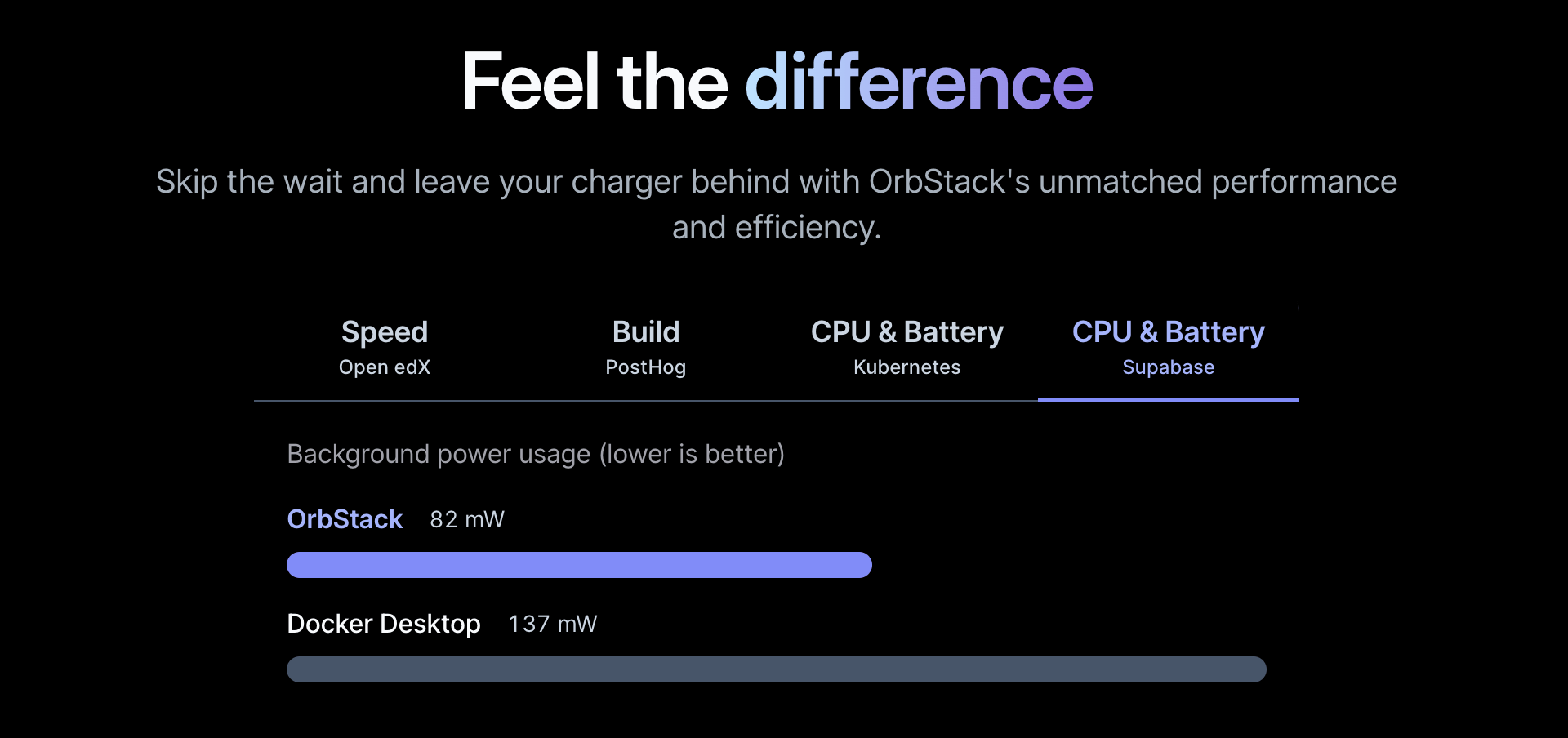

3、OrbStack(免费)

OrbStack是一款专为macOS设计的快速、轻量级且易于操作的Docker容器工具,官方声称它比DockerDesktop速度更快。

4、code2prompt(开源)

Code2prompt是一个终端工具,能将代码库转化为单一的LLM提示,结合源码树结构,模板定制,以及令牌计数。

5、github-chinese(开源)

GitHub汉化的浏览器插件脚本,需要借助Tampermonkey去使用。GitHub 中文化插件 - GreasyFork 托管 - 发布版

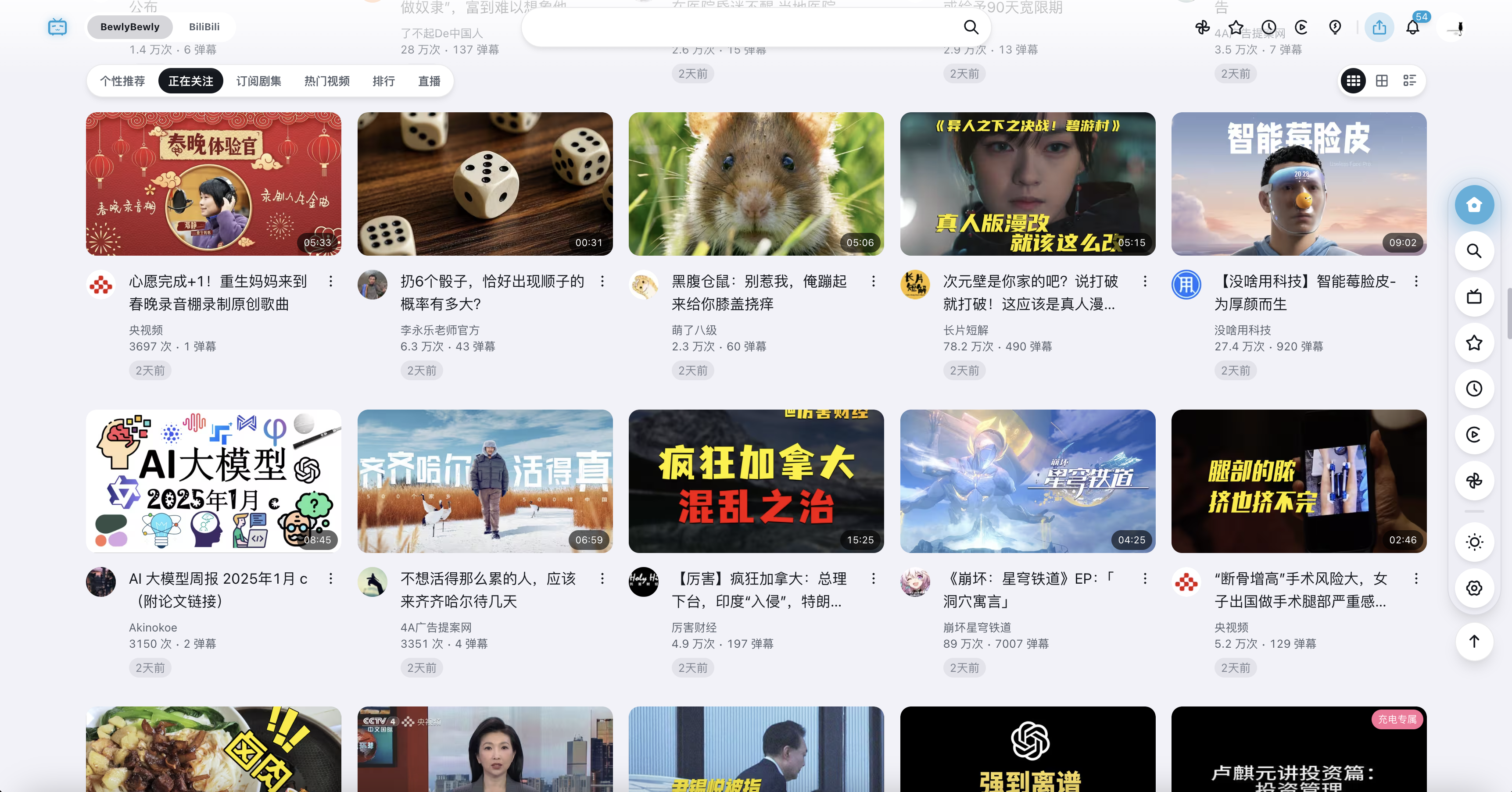

6、BewlyBewly(开源)

BewlyBewly 是一个用于 BiliBili 的浏览器扩展,旨在通过重新设计 BiliBili 用户界面来提升用户体验。设计灵感来自于 YouTube、Vision OS 和 iOS,从而实现了更具视觉吸引力和用户友好性的界面。Chrome插件安装地址

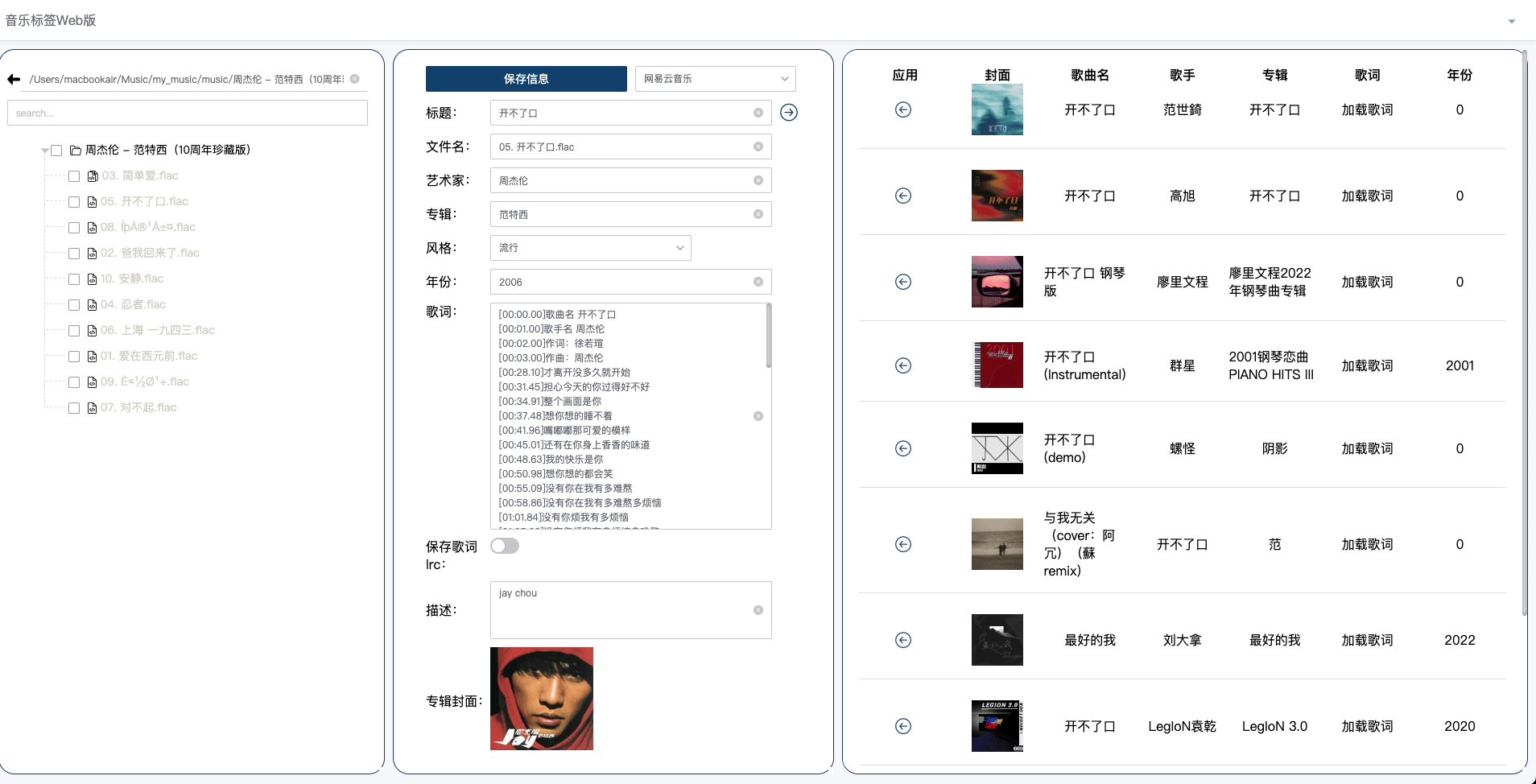

7、Music Tag Web(开源)

一款可以编辑歌曲的标题,专辑,艺术家,歌词,封面等元数据信息的Web工具。

六、学习资源

1、从零训练微型语言模型MiniMind(中文)

旨在完全从0开始,最快仅用3小时,即可训练出仅为26.88M大小的微型语言模型MiniMind。

七、生活经验

1、梁文锋专题访谈

DeepSeek V3是来自杭州的量化基金公司幻方量化,一经发布,它就引起了国际范围的轰动。目前,它在大模型排行榜排名第7,在前十名里面,只有它是开源模型。它的训练成本很低,估计只有Meta的Llama 3.1 405B模型的1/11,而后者的效果还不如它。这也就是说,DeepSeek 找到了高效使用硬件、提高模型效果的方法。下面是幻方量化创始人梁文锋在专题访谈里说过的一些话:

- 我们要做的不是生成式 AI,而是通用人工智能 AGI。前者只是后者的必经之路,AGI 会在我们有生之年实现。

- 任何 AI 公司(短期内)都没有碾压对手的技术优势,因为有 OpenAI 指路,又都基于公开论文和代码,大厂和创业公司都会做出自己的大语言模型。

- 在颠覆性的技术面前,闭源形成的护城河是短暂的。即使 OpenAI 闭源,也无法阻止被别人赶超。我们把价值沉淀在团队上,我们的同事在这个过程中得到成长,积累很多know-how,形成可以创新的组织和文化,就是我们的护城河。

- 我们不会闭源。我们认为先有一个强大的技术生态更重要。

- 当前阶段是技术创新的爆发期,而不是应用的爆发期。大模型应用门槛会越来越低,创业公司在未来20年任何时候下场,也都有机会。

- 过去很多年,很多的中国公司习惯了别人做技术创新,拿过来做应用变现,自己等着摩尔定律从天而降,躺在家里18个月就会出来更好的硬件和软件。我们的出发点,就不是趁机赚一笔,而是走到技术的前沿,去推动整个生态发展。中国也要逐步成为贡献者,而不是一直搭便车。

- 大部分中国公司习惯 Follow,而不是创新。中国创新缺的不是资本,而是缺乏信心以及不知道怎么组织高密度的人才。我们没有海外回来的人,都是本土的。前50名顶尖人才可能不在中国,但也许我们能自己打造这样的人。

- 我们每个人对于卡和人的调动是不设上限的。如果有想法,每个人随时可以调用训练集群的卡无需审批。同时因为不存在层级和跨部门,也可以灵活调用所有人,只要对方也有兴趣。

- 我们选人的标准一直都是热爱和好奇心,所以很多人会有一些奇特的经历,很有意思。很多人对做研究的渴望,远超对钱的在意。

- 我们在做最难的事。对顶级人才吸引最大的,肯定是去解决世界上最难的问题。其实,顶尖人才在中国是被低估的。因为整个社会层面的硬核创新太少了,使得他们没有机会被识别出来。我们在做最难的事,对他们就是有吸引力的。

- 中国产业结构的调整,会更依赖硬核技术的创新。很多人发现过去赚快钱很可能来自时代运气,现在赚不到了,就会更愿意俯身去做真正的创新。

- 我是八十年代在广东一个五线城市长大的,我的父亲是小学老师,九十年代,广东赚钱机会很多,当时有不少家长觉得读书没用。但现在回去看,观念都变了,因为钱不好赚了,连开出租车的机会可能都没了。一代人的时间就变了,以后硬核创新会越来越多,因为整个社会群体需要被事实教育,当这个社会让硬核创新的人功成名就,群体性想法就会改变,我们只是还需要一堆事实和一个过程。

南美洲的亚马逊河是世界第二长的河流,仅次于非洲的尼罗河。但是,这条河却是唯一一条没有任何桥梁的世界主要河流,原因如下:

- 首先,每年的雨季,亚马逊河都会泛滥,河流的宽度会从旱季的5公里变成50公里,很难造桥,变成下图所示的样子。

- 其次,亚马逊河沿岸人烟稀少,只有很少几个城镇。最大一个城市的人口只有50万,不存在前往河对岸的强烈需求。

- 最后,亚马逊河两岸都是原始森林,并没有现成道路。如果造桥就需要砍伐大量森林,修建引桥和公路,环境代价很大。

3、有利息的工作

银行存款有利息,存得越久,利息越多。工作也是一样,也有利息,如果今年的工作可以节省明年或未来的工作时间,就是一份有利息的工作。工作有利息,意味着你未来的工作时间会变少,多出来的时间,就可以去做别的事情,创造更多的价值。这提示我们:

- 不要轻易更换工作领域,否则以前积累的利息就作废了。只有在同一个工作领域,才可能产生长期积累,以前的工作为以后打基础,最终产生巨大的利息。

- 在职业生涯的早期,积累效果最好,最容易产生复利。开始积累越晚,产生复利就越少。

- 有些劳动没有积累效果,不会产生利息,比如重复性的机械劳动(快递、咖啡店员、门卫……),你明年还是要重复做这些事情。

- 最好的人生策略就是,找到你深感兴趣、可以长期做下去的领域,在上面投入大量的工作时间(包括质量和数量),然后随着年龄增长,享受以前工作的复利。

八、闲情逸趣

九、数字与言论

1、保护海底光缆不出事是不可能的,你唯一能做的就是建立大量冗余,在不同位置铺设数十根光缆可能比保护它们更便宜。——Hacker News

2、摩尔定律预测,芯片性能大约每年会翻一番。但是,AI 芯片的发展速度比这快得多。今天我们发布的 GB200 NVL72 芯片,运行 AI 推理的速度,比去年的上一代 H100 快了30倍,比10年前的芯片快了1000倍。我们正在超越摩尔定律,AI 适用超级摩尔定律。——黄仁勋